Yapay zeka çağında siber tehditlerin üstesinden gelmek ve savunmayı güçlendirmek

Bugünlerde siber güvenlik dünyası büyük bir dönüşüm geçiriyor. Yapay zeka (AI) da hem bir tehdit hem de bir fırsat olarak bu değişimin ön saflarında yer alıyor. Yapay zeka; kurumların siber saldırıları makine hızında bertaraf etmesine ve tehdit algılama, tehdit avcılığı ve olay yanıtı konularında yenilik ve verimlilik elde etmesine destek olsa da saldırganlar da yapay zekayı saldırılarının bir parçası olarak kullanabilir. Bu nedenle yapay zekayı güvenli şekilde tasarlamak, dağıtmak ve kullanmak artık hiç olmadığı kadar önemli.

Microsoft olarak yapay zekanın; güvenlik önlemlerini iyileştirme, yeni ve gelişmiş koruma yöntemleri elde etme ve daha iyi yazılımlar geliştirme konularındaki potansiyelini araştırıyoruz. Yapay zeka bize; gelişen tehditlere uyum sağlama, anormallikleri anında tespit etme, riskleri etkisiz hale getirmek için hızlı bir şekilde yanıt verme ve savunmaları bir kuruluşun ihtiyaçlarına göre uyarlama gücünü veriyor.

Yapay zeka, sektörün en büyük zorluklarından bir diğerinin üstesinden gelmemize de yardımcı olabilir. Dünya genelinde yaklaşık 4 milyon siber güvenlik uzmanı ihtiyacıyla siber güvenlik sektöründe küresel boyutta bir personel yetersizliği mevcut ve yapay zeka, bu açığı kapatmak ve savunma birimlerinin daha üretken olmalarına yardımcı olmak için çok önemli bir araç olma potansiyeline sahip.

Güvenlik için Copilot’ın, uzmanlık seviyesi ne olursa olsun tüm güvenlik analistlerine yardımcı olabildiğini, yapılan bir çalışmada gördük. Tüm görevler genelinde katılımcılar yüzde 44 daha isabetli ve yüzde 26 daha hızlıydı.

Geleceği güvence altına almaya çalışırken yapay zekaya güvenle hazırlanmak ve yapay zekanın avantajlarından yararlanmak arasında da bir denge kurmak zorundayız çünkü yapay zeka, insanın potansiyelini artıracak ve yaşadığımız büyük zorluklardan bazılarını çözebilecek güce sahip.

Yapay zeka ile daha güvenli bir gelecek için yazılım mühendisliğinde bazı temel ilerlemeler kaydedilmesi gerekiyor. Tüm güvenlik stratejilerinin temel bir parçası olarak yapay zeka destekli tehditleri anlamamız ve bunlara yanıt verebilmemiz şart. Ayrıca kötü aktörlere karşı savaşta, kamu ve özel sektör genelinde derin bir işbirliği ve ortaklık sağlamak üzere de çalışmamız gerekiyor.

Bu çabanın ve kendi Güvenli Gelecek Girişimimizin bir parçası olarak bugün OpenAI ve Microsoft, tehdit aktörlerinin, büyük dil modellerinin (LLM) saldırı tekniklerine faydasını test etme ve araştırma çabalarını ayrıntılı olarak inceleyen yeni bir analiz yayımlıyor.

Hep birlikte daha güvenli bir gelecek arzuladığımız için bu bilgilerin tüm sektörlere faydalı olmasını umuyoruz. Çünkü nihayetinde hepimiz savunma tarafındayız.

Kurumsal Başkan Yardımcısı, Siber Güvenlik Baş Danışmanı

Microsoft Güvenlik Kurumsal Başkan Yardımcısı Vasu Jakkal’ın; yapay zeka çağında siber tehditler, Microsoft’un gelişmiş güvenlik için yapay zekayı nasıl kullandığı ve kurumların, savunmalarını güçlendirmek için neler yapabileceği konusunda önde gelen tehdit analizi uzmanlarıyla yaptığı görüşmeleri izleyin.

Saldırganlar, yapay zeka teknolojilerini araştırıyor

Siber tehdit ortamı, saldırganların giderek daha motive ve daha karmaşık olması ve daha iyi kaynaklara sahip olmasıyla her geçen gün daha zorlu hale geliyor. Hem tehdit aktörleri hem de savunma oyuncuları, üretkenliklerini artırmak ve hedefleri ve saldırı tekniklerine uyacak erişilebilir platformlardan yararlanmak için LLM’ler de dahil olmak üzere yapay zekaya yöneliyor.

Bugün, hızla gelişen tehdit ortamı karşısında Microsoft’un; gelişmiş kalıcı tehditler (APT), gelişmiş kalıcı manipülatörler (APM) ve siber suç örgütleri dahil olmak üzere, tehdit aktörlerinin yarattığı riski azaltmak için yapay zeka platformları ve API’ler kullanarak yaptığımız eylemlere rehberlik eden prensiplerini duyuruyoruz. Bu prensipler arasında tehdit aktörlerinin yapay zeka kullanımını tanımlama ve buna karşı harekete geçme, diğer yapay zeka hizmet sağlayıcılarını bilgilendirme, diğer paydaşlarla işbirliği ve şeffaflık bulunuyor.

Tehdit aktörlerinin gerekçeleri ve karmaşıklık seviyesi değişiklik gösterse de saldırıları gerçekleştirirken yaptıkları bazı hamleler ortaktır. Bunlar arasında potansiyel kurbanların sektör, konum ve ilişkilerinin araştırılması gibi keşif çalışmaları; yazılım betiklerinin iyileştirilmesi ve kötü amaçlı yazılım geliştirilmesi de dahil olmak üzere kodlama ve hem insan hem de makine dillerini öğrenme ve kullanma konusunda yardım bulunur.

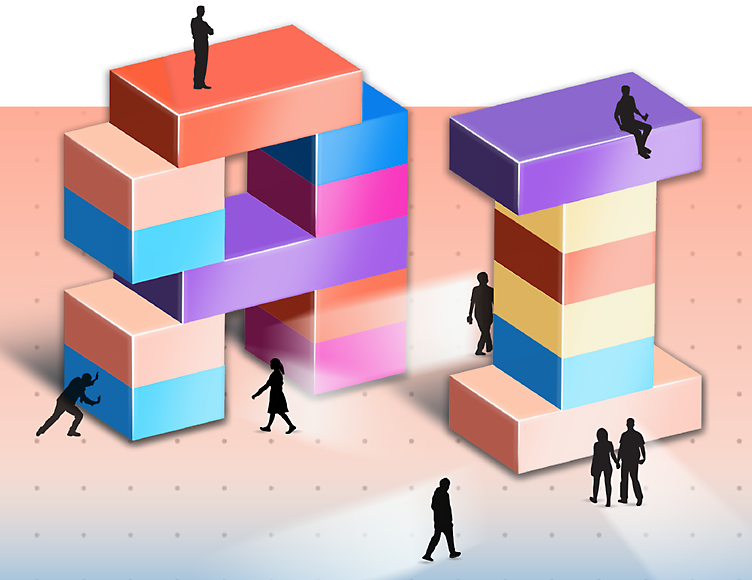

OpenAI ile işbirliği içinde, siber operasyonlarını güçlendirmek için LLM'leri kullandığı tespit edilen ve Forest Blizzard, Emerald Sleet, Crimson Sandstorm, Charcoal Typhoon ve Salmon Typhoon olarak belirlediğimiz, devlete bağlı düşmanları gösteren tehdit analizini paylaşıyoruz.

Microsoft'un araştırma için OpenAI ile ortaklık yapmasının amacı, toplumu potansiyel kötüye kullanımdan korumak için en güçlü etik uygulama standartlarını koruyarak ChatGPT gibi yapay zeka teknolojilerinin güvenli ve sorumlu bir şekilde kullanılmasını sağlamaktır.

Emerald Sleet, LLM’i düşünce kuruluşları ve Kuzey Kore uzmanları hakkında araştırma yapmanın yanı sıra hedefli kimlik avı kampanyalarında kullanılabilecek içerik üretimi için de kullanmıştır. Ayrıca Emerald Sleet, kamuoyunca bilinen güvenlik açıklarını anlamak, teknik sorunları gidermek ve çeşitli web teknolojilerini kullanma konusunda yardım almak için de LLM'lerle etkileşime girmiştir.

Bir diğer Çin destekli grup olan Salmon Typhoon, 2023 yılı boyunca potansiyel olarak hassas konular, yüksek profilli kişiler, bölgesel jeopolitik, ABD etkisi ve iç meseleler hakkında bilgi sağlamak için LLM'leri kullanmanın etkinliğini değerlendirmiştir. LLM'lerle kurulan bu belirsiz etkileşim, hem istihbarat toplama araç setinin genişletildiğini hem de yeni teknolojilerin yeteneklerinin değerlendirilmesinde deneysel bir aşamayı gösteriyor olabilir.

OpenAI ile yaptığımız araştırmada , yakından izlediğimiz LLM'leri kullanan önemli saldırılar tespit edilmedi.

Bu tehdit aktörleriyle ilişkili varlıkları ve hesapları bozmak ve modellerimizin etrafındaki korkulukları ve güvenlik mekanizmalarını şekillendirmek içinse bazı önlemler aldık.

Bir başka kritik endişe sebebi de yapay zeka destekli dolandırıcılıktır. Üç saniyelik bir ses örneğinin, modeli herhangi biri gibi konuşacak şekilde eğitebildiği ses sentezi, bunun bir örneği. Sesli mesaj karşılama mesajınız gibi zararsız bir şey bile örnek elde etmek için yeterli olabilir.

Birbirimizle etkileşim kurma ve iş yapma yöntemlerimizin çoğu, bir kişinin sesini, yüzünü, e-posta adresini veya yazı stilini tanımak gibi kimlik kanıtlarına dayanır.

Karmaşık dolandırıcılık vakaları ve kimlikleri gizleyen diğer yeni sosyal mühendislik tehditleriyle mücadele edebilmek için kötü niyetli aktörlerin uzun süredir mevcut olan kimlik kanıtlama sistemlerini, yapay zekayı kullanarak nasıl zayıflattığını anlamamız çok önemlidir.

Yapay zeka, şirketlerin dolandırıcılık girişimlerini engellemelerine yardımcı olmak için de kullanılabilir. Yapay zeka sistemlerimiz, Microsoft olarak ilişkimizi sonlandırdığımız, Brezilya'da bulunan bir şirketin ekosistemimize yeniden girmek için kendini yeniden oluşturmaya çalıştığını tespit etti.

Grup sürekli olarak bilgilerini ve sahiplik kökenlerini gizleyerek yeniden giriş yapmaya çalışsa da yapay zeka algılayıcılarımız, bu dolandırıcı şirketi işaretlemek ve daha önce tanınan şüpheli davranışlarla ilişkilendirmek için yaklaşık bir düzine risk sinyalini kullanarak bu girişimleri engelledi.

Microsoft; insanların gözetim sağladığı, itirazları değerlendirdiği ve ilke ve düzenlemeleri yorumladığı, gizlilik ve güvenlik sunan, sorumlu, insan liderliğindeki yapay zekaya kendini adamıştır.

- Koşullu erişim ilkelerini kullanın: Bu ilkeler; risk sinyalleri, lisanslama ve kullanıma bağlı şekilde kiracıları otomatik olarak koruyacak güvenlik duruşunuzu güçlendirmek için açık, kendi kendinize yararlanabileceğiniz bir kılavuz görevi görür. Koşullu erişim politikaları özelleştirilebilir ve değişen siber tehdit ortamına uyum sağlar.

- Çalışanları sosyal mühendislik taktikleri konusunda tekrar tekrar eğitin: Çalışanları ve halkı kimlik avı e-postaları, vishing (sesli posta), smishing (SMS/metin), sosyal mühendislik saldırılarını tanıma ve bunlara tepki verme konusunda eğitin ve Microsoft Teams için en iyi güvenlik deneyimlerini uygulayın.

- Verileri titizlikle koruyun: Verilerin gizli kalmasını ve uçtan uca kontrol edilmesini sağlayın.

- Üretici AI güvenlik araçlarından yararlanın: Güvenlik için Microsoft Copilot gibi araçlar yetenekleri artırabilir ve kurumun güvenlik duruşunu geliştirebilir.

- Çok faktörlü kimlik doğrulamayı etkinleştirin: Hesapların ele geçirilme riskini yüzde 99'un üzerinde azalttığından, yönetici işlevleri başta olmak üzere tüm kullanıcılar için çok faktörlü kimlik doğrulamayı etkinleştirin.

Saldırılara karşı savunma

Microsoft, günde 65 trilyondan fazla siber güvenlik sinyali ile muazzam miktarda kötü amaçlı trafik tespit ediyor. Yapay zeka da bu bilgileri analiz etme ve tehditleri durdurabilmek için en değerli içgörüleri ortaya çıkarma becerimizi artırıyor. Bu sinyal analizini; savunma oyuncularımızın, başkalarının gözden kaçırdıklarını yakalamasına yardımcı olmak için Üretici AI’ı gelişmiş tehdit koruması, veri güvenliği ve kimlik güvenliği konularında güçlendirmek için de kullanıyoruz.

Microsoft kendisini ve müşterilerini siber tehditlerden korumak için aralarında; ağdaki kaynakların veya trafiğin nasıl kullanıldığına dair değişiklikleri tespit etmek için yapay zeka destekli tehdit algılama, riskli oturum açma işlemlerini ve anormal davranışları tespit etmek için davranışsal analiz, riskli oturum açma işlemlerini ve kötü amaçlı yazılımları tespit etmek için makine öğrenimi (ML) modelleri; her erişim talebinin tamamen doğrulanması, yetkilendirilmesi ve şifrelenmesi gereken Sıfır Güven modelleri ve bir cihazın, kurumsal bir ağa bağlanmadan önce cihaz sağlığının doğrulanmasının da bulunduğu çeşitli yöntemler kullanır.

Tehdit aktörleri, tüm çalışanları MFA veya parolasız korumaya sahip olan Microsoft'un, kendisini korumak için çok faktörlü kimlik doğrulamayı (MFA) titizlikle kullandığını bildiğinden saldırganların, çalışanlarımızı tehlikeye atmak için sosyal mühendisliğe yöneldiğini gördük.

Bu konudaki etkin noktalar arasında ücretsiz denemeler veya hizmetlerin veya ürünlerin promosyon fiyatlandırması gibi değerli şeylerin iletildiği alanlar bulunuyor. Bu alanlarda, her seferinde bir abonelik çalmak saldırganlar için karlı olmadığından, bu saldırıları tespit edilmeden operasyonel hale getirmeye ve ölçeklendirmeye çalışırlar.

Doğal olarak biz de hem Microsoft hem de müşterilerimiz için bu saldırıları algılayacak yapay zeka modelleri oluşturuyoruz. Sahte öğrenci ve okul hesaplarını, yaptırımlardan kaçınmak, denetimleri atlatmak veya yolsuzluk mahkumiyetleri, hırsızlık girişimleri gibi geçmiş suç ihlallerini gizlemek için karakteristik verilerini değiştiren veya gerçek kimliklerini gizleyen sahte şirket veya kuruluşları tespit ediyoruz.

GitHub Copilot, Güvenlik için Microsoft Copilot ve iç mühendislik ve operasyon altyapımıza bütünleştirilmiş diğer copilot sohbet özelliklerinin kullanımı da operasyonları etkileyebilecek olayların önlenmesine yardımcı oluyor.

Microsoft, e-posta tehdidi sorununu çözmek için bir e-postanın kötü niyetli olup olmadığını anlamak üzere, e-postanın yapısı dışındaki işaretleri de tespit etme yeteneklerini geliştiriyor. Yapay zekanın tehdit aktörlerinin eline geçmesiyle birlikte, kimlik avı girişimlerini ortaya çıkaran bariz dil ve gramer hatalarını düzelterek kimlik avı girişimlerinin tespit edilmesini zorlaştıran mükemmel yazılmış e-postaların sayısı arttı.

Yüzde 100 insan hatasına dayanan tek kaldıraç olan sosyal mühendislikle mücadeleye destek olmak için çalışan eğitimleri ve kamu farkındalığı kampanyalarının sürekli olarak yapılması gerekir. Tarih bize, etkili kamuoyu bilinçlendirme kampanyalarının, davranışları değiştirebildiğini gösterdi.

Microsoft, özellikle saldırganların sorumlu uygulamalar ve yerleşik güvenlik kontrolleri olmadan çalışan yapay zeka teknolojileri bulmaları halinde, yapay zekanın sosyal mühendislik taktiklerini geliştirerek deepfake ve ses klonlama gibi daha karmaşık saldırılar yaratacağını öngörmektedir.

Ve ister geleneksel ister yapay zeka destekli olsun, tüm siber tehditlerle mücadelenin anahtarı, saldırıları önlemektir.

Öneriler:

Veri ve Uygulamalı Bilim Müdürü, Algılama Analiz Müdürü Homa Hayatafar'dan yapay zeka hakkında daha fazla içgörü alın.

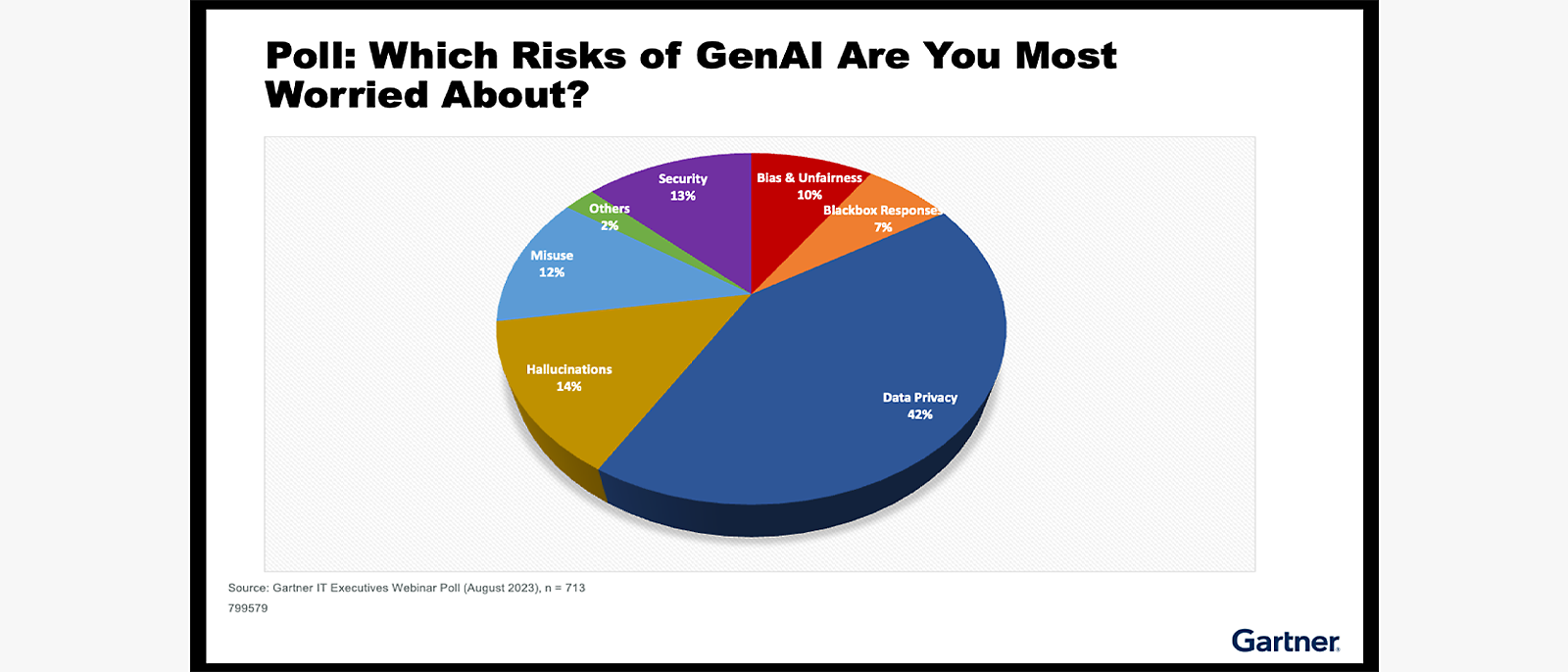

Geleneksel araçlar artık siber suçluların oluşturduğu tehditlere ayak uyduramıyor. Son siber saldırıların artan hızı, ölçeği ve karmaşıklığı, yeni bir güvenlik yaklaşımına sahip olmayı gerektiriyor. Buna ek olarak siber güvenlik alanındaki iş gücü açığı ve siber tehditlerin sıklığı ve şiddetindeki artış düşünüldüğünde, bu beceri açığını kapatmanın acil bir ihtiyaç olduğu da görülüyor.

Yapay zeka savunma oyuncuları için dengeleri değiştirebilir. Şu anda müşteri önizleme testinde olan Güvenlik için Microsoft Copilot üzerinde yapılan yakın tarihli bir çalışma; saldırganlar tarafından kullanılan betikleri tanımlama, olay raporları oluşturma ve uygun düzeltme adımlarını belirleme gibi ortak görevlerde, uzmanlık seviyesi ne olursa olsun tüm güvenlik analistlerinin hızı ve doğruluğunun arttığını gösteriyor..1

- [1]

Metodoloji:1 Anlık görüntü verileri, Güvenlik için Microsoft Copilot kullanımının üretkenlik üzerindeki etkisini ölçmek için 149 kişiyi test ettiğimiz rastgele kontrollü bir çalışmayı (RCT) temsil etmektedir. Bu RCT'de, Copilot'ı rastgele bir şekilde bazı analistlere verdik, bazılarına ise vermedik ve daha sonra herhangi bir temel etkiden ayrı olarak Copilot'ın etkisini görmek için performanslarını ve duygularını ölçtük. Copilot'ın "kariyerinde yeni olan" analistlere nasıl yardımcı olduğunu test edebilmemiz için katılımcılar, temel BT becerilerine sahip olmakla birlikte güvenlik konusunda acemi olan kişilerdi. Güvenlik için Microsoft Copilot RCT’si, Microsoft Office of the Chief Economist tarafından Kasım 2023'te gerçekleştirildi. Microsoft Entra ID de buna ek olarak kötü amaçlı e-posta hesapları, kimlik avı e-postaları ve ağlardaki saldırgan hareketleri gibi tehdit etkinliklerine ilişkin anonimleştirilmiş veriler sağladı. Ek içgörüler; bulut, uç noktalar, akıllı uç, Güvenlik İhlalinden Kurtarma Uygulaması ve Algılama ve Yanıt Ekiplerimiz, ve Microsoft Defender’ın da aralarında bulunduğu Microsoft platform ve hizmetlerinden gelen telemetri dahil olmak üzere, Microsoft genelinde her gün alınan 65 trilyon güvenlik sinyalinden ve 2023 Microsoft Dijital Savunma Raporu’ndan elde edilmiştir.